Proč nesmíme stavět autonomní válečné roboty | Kapitola 2

Seznam kapitol

Tento týden, v úterý 28. července 2015, byl zveřejněn otevřený dopis vědců a vývojářů z oblasti umělé inteligence a robotiky, který požaduje zákaz vývoje a výroby autonomních zbraňových systémů. Pokud by se na půdě OSN podařilo zákaz prosadit, vražední roboti by se ocitli na seznamu zakázaných zbraní vedle biologických a chemických.

To, co je opravdu důležité, je „sladění umělé inteligence se zájmy lidstva“, což je obrat, který pravděpodobně nejlépe vystihuje podstatu problému. Inteligence samotná je něco jako kubatura motoru, nelze z ní samotné určit, zda motor nakonec použijete v autobusu anebo v tanku a pokud se rozhodnete postavit auto, zda bude dobré anebo špatné. To vše je otázkou kontextu použití. Pokud se tohle nenaučíte rozlišovat, dopadnete jako zelení protijaderní aktivisté, kteří mají potíže rozeznat mírové a vojenské použití jaderné energie a mají problém rozlišit mezi jadernou hlavicí a jaderným reaktorem na palubě kosmické sondy.

Ostatně dva a půl tisíce výzkumníků z oblasti AI rozhodně nepodepsalo petici proto, aby byla umělá inteligence zakázaná jako taková. Anebo aby byla zakázaná autonomní inteligence. Schopnost robota samostatně uvažovat a rozhodovat se je jednoznačně pozitivní, ať už jde o robota, který zkoumá vesmír příliš daleko od Země, než aby poslouchal rozkazy, robota, který hledá zraněné příliš hluboko v sutinách, autopilota, který rozezná kolaps pilota a dovede sám letadlo bezpečně dovést na přistání, anebo domácího robota, který se snaží rozeznat, zda jste si jenom lehli anebo zda jste dostali infarkt a měl by tedy zavolat pomoc.

Myslím si, že poměrně solidní náhled na roli robotů v lidské společnosti přinesly původní zákony robotiky, které v povídce „Hra na honěnou“ publikoval v roce 1942 Isaac Asimov:

- 1) Robot nesmí ublížit člověku nebo svou nečinností dopustit, aby bylo člověku ublíženo.

- 2) Robot musí uposlechnout příkazů člověka, kromě případů, kdy jsou tyto příkazy v rozporu s prvním zákonem.

- 3) Robot musí chránit sám sebe před poškozením, kromě případů, kdy je tato ochrana v rozporu s prvním nebo druhým zákonem.

Tyhle zákony byly od data svého vzniku doplňovány a kritizovány, hlavně v tom duchu, že vypadají spíš jako otrokářské zákony a že to není dobrá sada pravidel pro případ, že by AI dosáhla opravdu velmi vysoké inteligence. Roger MacBride Allen je například doplnil o klauzuli, která roboty z otroků mění na spíše podřízené, ale jinak je v podstatě osvobozuje, pokud dodržují původní zákony.

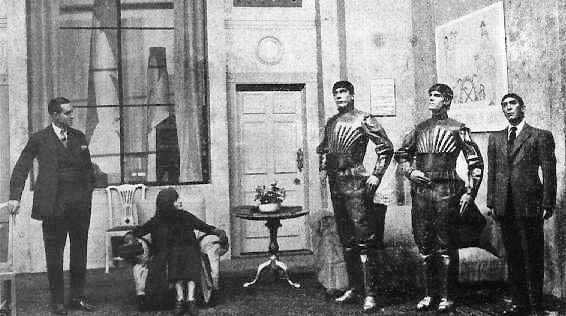

To, co spojuje nové i staré robotické zákony je představa, že se robot nesmí obrátit proti člověku. Představa robotů, ohrožujících existenci lidstva, najdeme ostatně už i v Čapkově dramatu R.U.R. z roku 1920.

"" by Unknown, uploaded to ar.wiki by ar:المستخدم:Classic 971 on

13 July 2006

,to en.wiki by en:User:Rocketmagnet on

4 December 2007

, to commons by User:Sreejithk2000 on2 June 2010

- http://www.umich.edu/~engb415/literature/pontee/RUR/RURsmry.html(via and ).

Licensed under Public Domain via Wikimedia Commons.

Při čtení tohoto díla je ale celkem jasně vidět, že jde spíš o sociální kritiku, podobně jako u filmu Metropolis Fritze Langa z roku 1927. V podstatě tu máme kolizi zotročených mas a pohodlných elit a nastupující proletářsko-robotí revoluce. Najdeme tam více paralel k Sovětskému Rusku a Republikám rad, než k dystopické vizi budoucnosti jako z Blade Runnera, kde se roboti chtějí pomstít svému tvůrci za zotročení.